|

|

|

【悲報】白人どころか東南アジアの男ですら日本人女性相手ならナンパしたその場で即路上ベロチューも余裕なことが判明

1 : /)`・ω・´) (ワッチョイ 9fde-W4Ob):2019/03/05(火) 11:09:59.91 ID:aqqRfiDQ0 BE:?-2BP(5556)

161 : 番組の途中ですがアフィサイトへの\(^o^)/です (アウアウウー Sa9b-WzxR):2019/03/05(火) 11:59:22.40 ID:WK1VaAbna

チョロくてワロタ

781 : 番組の途中ですがアフィサイトへの\(^o^)/です (ワッチョイ 9ff8-ehiW):2019/03/05(火) 21:28:50.30 ID:MUMUmY0p0

女から舌出してて草

776 : 番組の途中ですがアフィサイトへの\(^o^)/です (ワッチョイW ffc5-93RF):2019/03/05(火) 20:45:00.15 ID:sNx1ZVne0

自分の娘がこんなことしてたら泣くよな

≫続きを読んで世界ランクアップ!

161 : 番組の途中ですがアフィサイトへの\(^o^)/です (アウアウウー Sa9b-WzxR):2019/03/05(火) 11:59:22.40 ID:WK1VaAbna

チョロくてワロタ

781 : 番組の途中ですがアフィサイトへの\(^o^)/です (ワッチョイ 9ff8-ehiW):2019/03/05(火) 21:28:50.30 ID:MUMUmY0p0

女から舌出してて草

776 : 番組の途中ですがアフィサイトへの\(^o^)/です (ワッチョイW ffc5-93RF):2019/03/05(火) 20:45:00.15 ID:sNx1ZVne0

自分の娘がこんなことしてたら泣くよな

≫続きを読んで世界ランクアップ!

専業主婦さんが働いてるだけ(笑)のクソオスに激怒「外で働くってそんなに偉いんですか? 育児の9.5割は私がしてるんですけど? 」

1 : 番組の途中ですがアフィサイトへの\(^o^)/です:2019/03/02(土) 05:09:49.43 ID:oOailoaO0

外で働くことってそんなに偉いんですか?

トピを開いていただきありがとうございます。

読みづらい文章ですが、最後までお読みいただけたら幸いです。

私は、幼稚園児と乳飲み子のいる主婦です。

夫は仕事が多忙で7時前に家を出て帰宅は23時頃です。

休日も会社に行くことが多いです。

育児の9.5割は私がしています。

普段の言動から(特に喧嘩をしたとき)、夫は私が働いていないこと(専業主婦であること)を見下したような態度をとります。

時々私が「疲れた..」「少し休みたい..(ひとりの時間が欲しい)」など口にしてしまうのですが、

そうすると「じゃあ俺が会社やめて主婦になるからお前が外で働けよ」と言われます。

夫は、「専業主婦=楽な仕事」と思っているようです。

悔しいので、働きに出ようかとも思いましたが

正社員を辞めてしまった今、40過ぎたおばさんを正社員で雇ってくれる会社なんてないでしょうし、パート収入だけで家族を養うのは無理です。

乳飲み子もいるのでいまだに夜中も2時間おきに起こされます。

上の子が幼稚園にいってる間にも家事をしたり・・正直休む時間もありません。

子供が体調不良になれば日夜問わず私が付ききりで看病や通院です。

まぁ、これはどこの母親でも当てはまる一般的な母親の仕事だとは理解しています。

でも、頑張ってるのに「楽してる・・」と思われているのが悔しいです。苦しいです。

こういう感情から夫への愛情も薄れてきました。

確かに、外で働くのは大変です。専業主婦と精神的負担も違います。

自分を犠牲にして家族を養うだけの収入を得る。夫も頑張ってる。それはわかるんです。

でも、私だって収入がないだけで自分の任務を頑張ってる..

なのに見下されるって悔しいです。

https://komachi.yomiuri.co.jp/t/2014/0224/645170.htm

2 : 番組の途中ですがアフィサイトへの\(^o^)/です:2019/03/02(土) 05:10:23.80 ID:6tn/Czgc0

偉いに決まってんじゃんアホかな?

3 : 番組の途中ですがアフィサイトへの\(^o^)/です:2019/03/02(土) 05:11:31.70 ID:FmCHAU2p0

>夫も頑張ってる。それはわかってるんです

いや分かってないよね

10 : 番組の途中ですがアフィサイトへの\(^o^)/です:2019/03/02(土) 05:13:25.07 ID:vHLqJqYMM

替わればいいんじゃないの?

≫続きを読んで世界ランクアップ!

外で働くことってそんなに偉いんですか?

トピを開いていただきありがとうございます。

読みづらい文章ですが、最後までお読みいただけたら幸いです。

私は、幼稚園児と乳飲み子のいる主婦です。

夫は仕事が多忙で7時前に家を出て帰宅は23時頃です。

休日も会社に行くことが多いです。

育児の9.5割は私がしています。

普段の言動から(特に喧嘩をしたとき)、夫は私が働いていないこと(専業主婦であること)を見下したような態度をとります。

時々私が「疲れた..」「少し休みたい..(ひとりの時間が欲しい)」など口にしてしまうのですが、

そうすると「じゃあ俺が会社やめて主婦になるからお前が外で働けよ」と言われます。

夫は、「専業主婦=楽な仕事」と思っているようです。

悔しいので、働きに出ようかとも思いましたが

正社員を辞めてしまった今、40過ぎたおばさんを正社員で雇ってくれる会社なんてないでしょうし、パート収入だけで家族を養うのは無理です。

乳飲み子もいるのでいまだに夜中も2時間おきに起こされます。

上の子が幼稚園にいってる間にも家事をしたり・・正直休む時間もありません。

子供が体調不良になれば日夜問わず私が付ききりで看病や通院です。

まぁ、これはどこの母親でも当てはまる一般的な母親の仕事だとは理解しています。

でも、頑張ってるのに「楽してる・・」と思われているのが悔しいです。苦しいです。

こういう感情から夫への愛情も薄れてきました。

確かに、外で働くのは大変です。専業主婦と精神的負担も違います。

自分を犠牲にして家族を養うだけの収入を得る。夫も頑張ってる。それはわかるんです。

でも、私だって収入がないだけで自分の任務を頑張ってる..

なのに見下されるって悔しいです。

https://komachi.yomiuri.co.jp/t/2014/0224/645170.htm

2 : 番組の途中ですがアフィサイトへの\(^o^)/です:2019/03/02(土) 05:10:23.80 ID:6tn/Czgc0

偉いに決まってんじゃんアホかな?

3 : 番組の途中ですがアフィサイトへの\(^o^)/です:2019/03/02(土) 05:11:31.70 ID:FmCHAU2p0

>夫も頑張ってる。それはわかってるんです

いや分かってないよね

10 : 番組の途中ですがアフィサイトへの\(^o^)/です:2019/03/02(土) 05:13:25.07 ID:vHLqJqYMM

替わればいいんじゃないの?

≫続きを読んで世界ランクアップ!

【画像】Twitterには若者チ●ポ(若茎)を食い荒らす「茎活」を行う熟女が存在するらしい

20 : 番組の途中ですがアフィサイトへの\(^o^)/です (ヒッナーWW 17ae-FU3H):2019/03/03(日) 17:48:29.94 ID:F6iQgTWM0

23 : 番組の途中ですがアフィサイトへの\(^o^)/です (ヒッナー 17bf-SKB1):2019/03/03(日) 17:50:00.39 ID:xpxpc76m0

・・・😓

240 : 番組の途中ですがアフィサイトへの\(^o^)/です (ワッチョイ 9ff8-ehiW):2019/03/03(日) 22:06:47.91 ID:lXrT9JTD0

まじで明日仕事なのにどうしてくれんの?

21 : 番組の途中ですがアフィサイトへの\(^o^)/です (ヒッナーWW b75a-XA5H):2019/03/03(日) 17:49:00.88 ID:sA4xPZJg0

情報の暴力

≫続きを読んで世界ランクアップ!

23 : 番組の途中ですがアフィサイトへの\(^o^)/です (ヒッナー 17bf-SKB1):2019/03/03(日) 17:50:00.39 ID:xpxpc76m0

・・・😓

240 : 番組の途中ですがアフィサイトへの\(^o^)/です (ワッチョイ 9ff8-ehiW):2019/03/03(日) 22:06:47.91 ID:lXrT9JTD0

まじで明日仕事なのにどうしてくれんの?

21 : 番組の途中ですがアフィサイトへの\(^o^)/です (ヒッナーWW b75a-XA5H):2019/03/03(日) 17:49:00.88 ID:sA4xPZJg0

情報の暴力

≫続きを読んで世界ランクアップ!

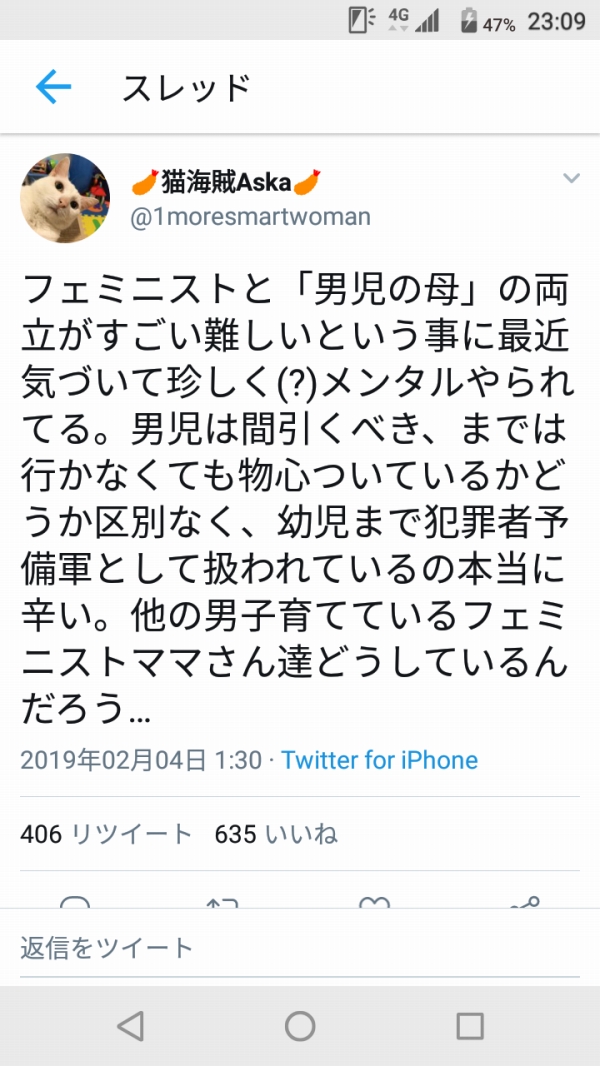

【悲報】男を憎むフェミニスト女性さん、男児を産んでしまい狂う 「ほかのフェミママはどうしてるんだろう…」

1 : ちちちち~ん:2019/02/05(火) 23:10:00.87 ID:pcvV64zCd

28 : 番組の途中ですがアフィサイトへの\(^o^)/です:2019/02/05(火) 23:20:30.53 ID:Igkek39U0

狂ってる

8 : 番組の途中ですがアフィサイトへの\(^o^)/です:2019/02/05(火) 23:13:51.82 ID:FI+xsuW4M

馬鹿なのか?

16 : 番組の途中ですがアフィサイトへの\(^o^)/です:2019/02/05(火) 23:17:11.14 ID:vcSR7NtL0

なんでそこまで男を憎悪してるのにセックスしてんだよ。

≫続きを読んで世界ランクアップ!

28 : 番組の途中ですがアフィサイトへの\(^o^)/です:2019/02/05(火) 23:20:30.53 ID:Igkek39U0

狂ってる

8 : 番組の途中ですがアフィサイトへの\(^o^)/です:2019/02/05(火) 23:13:51.82 ID:FI+xsuW4M

馬鹿なのか?

16 : 番組の途中ですがアフィサイトへの\(^o^)/です:2019/02/05(火) 23:17:11.14 ID:vcSR7NtL0

なんでそこまで男を憎悪してるのにセックスしてんだよ。

≫続きを読んで世界ランクアップ!

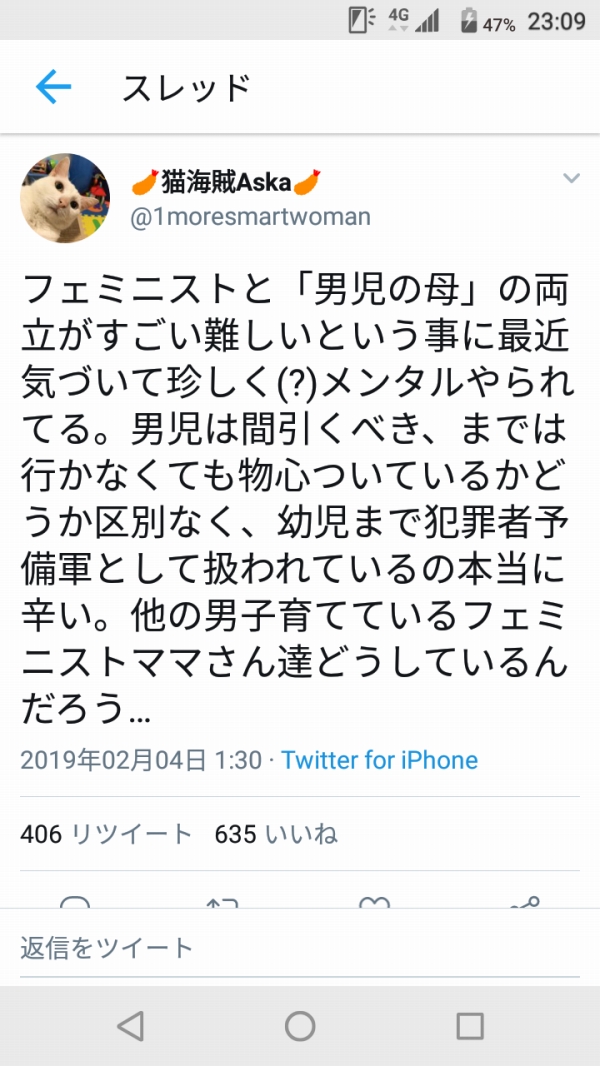

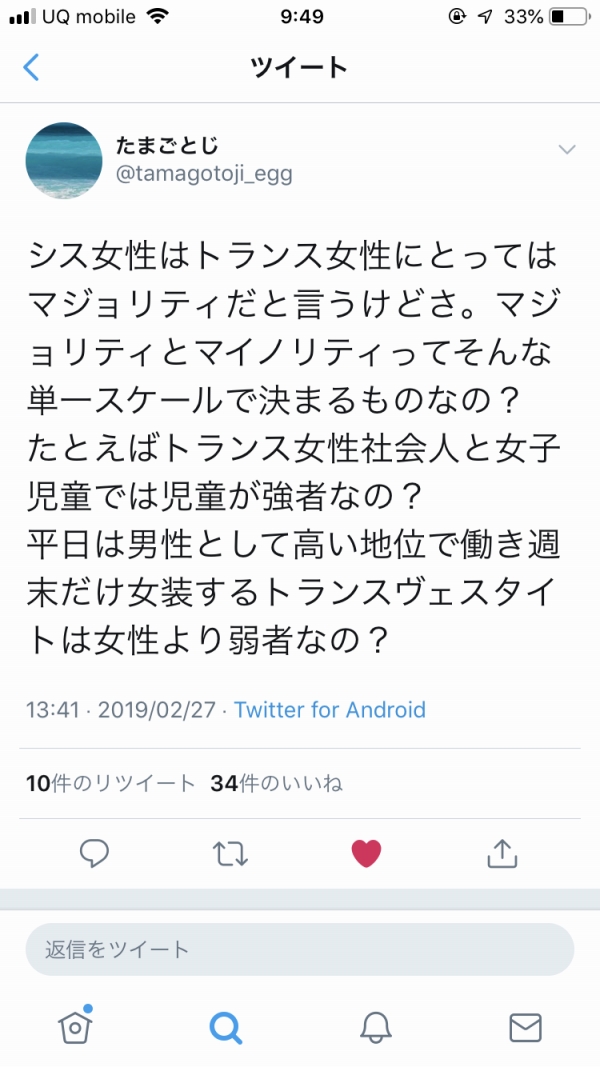

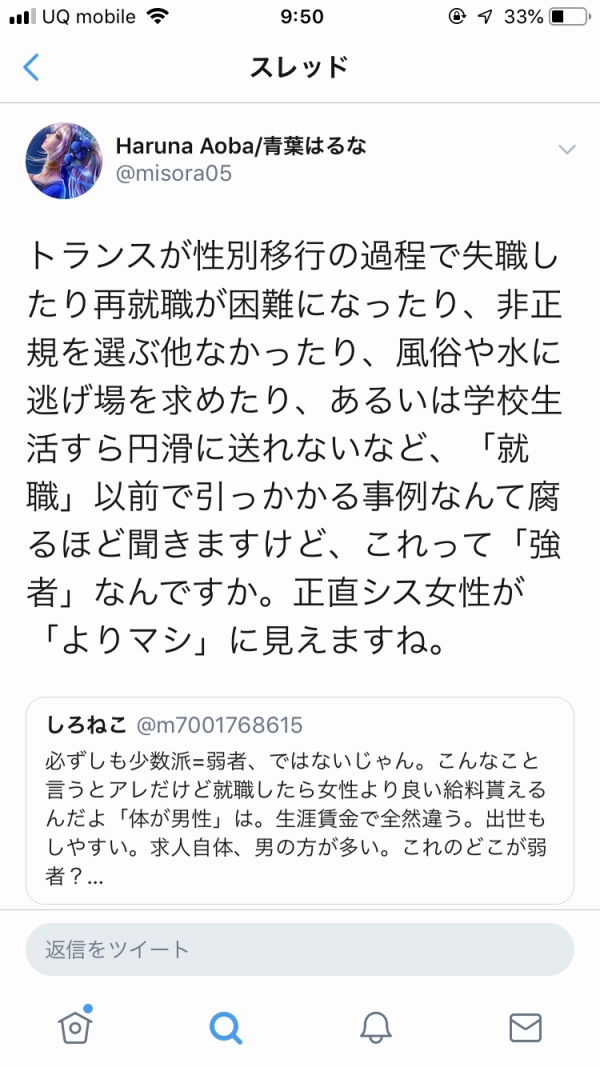

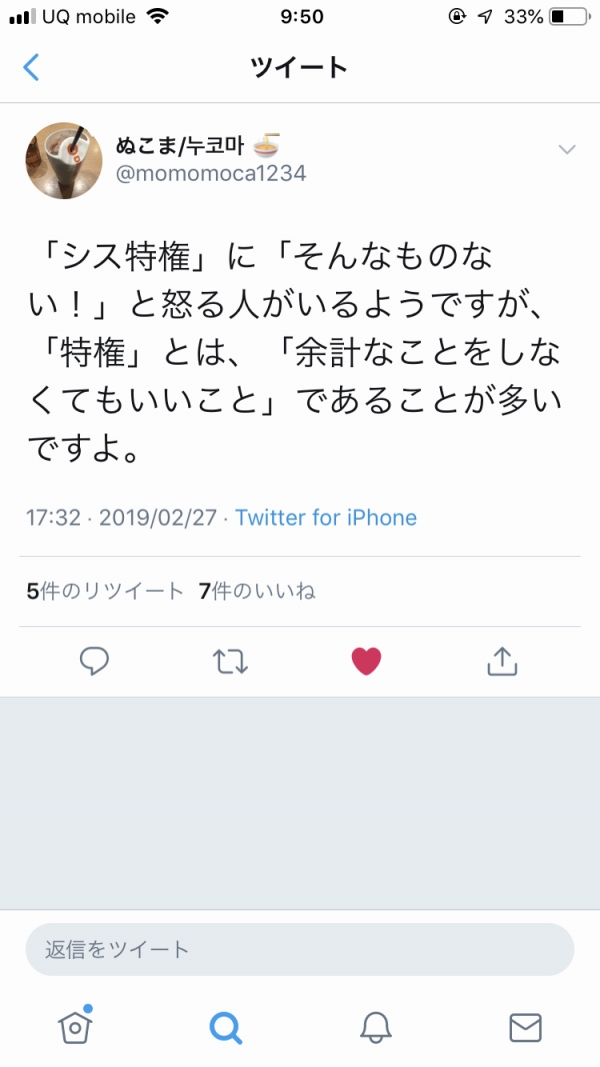

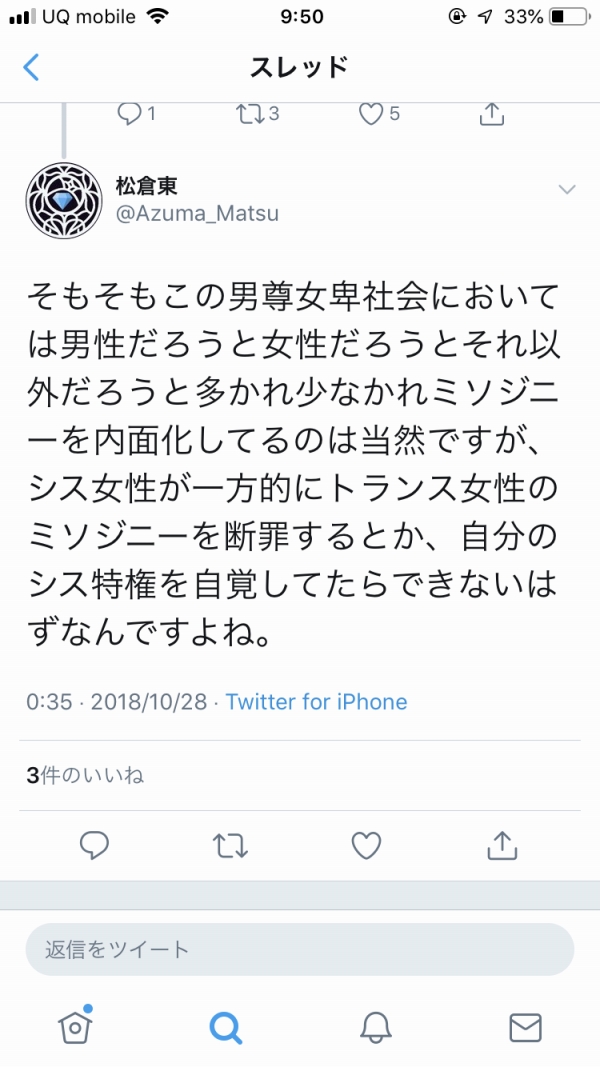

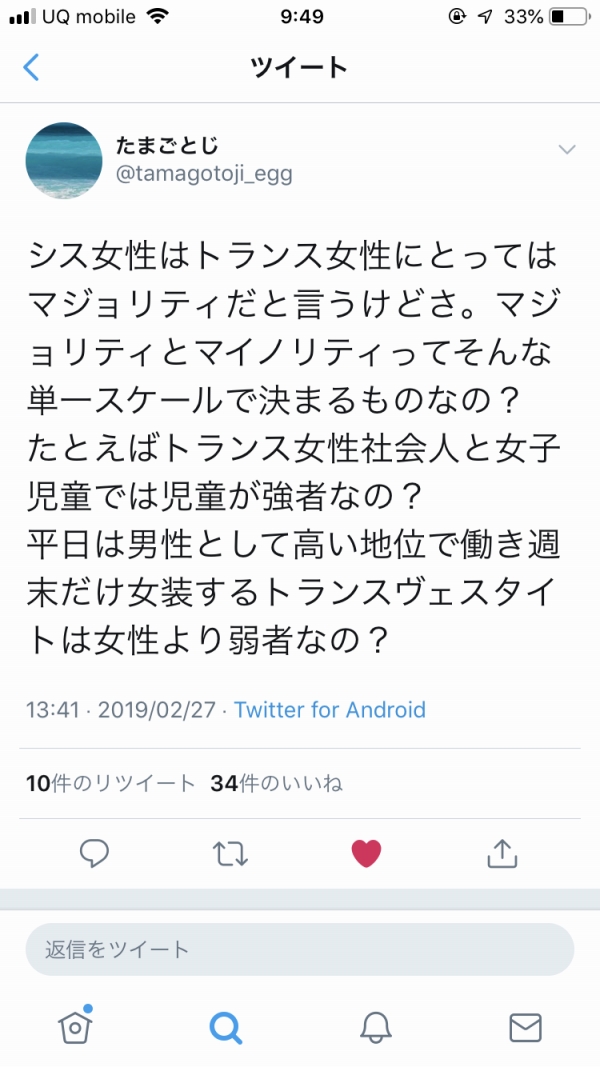

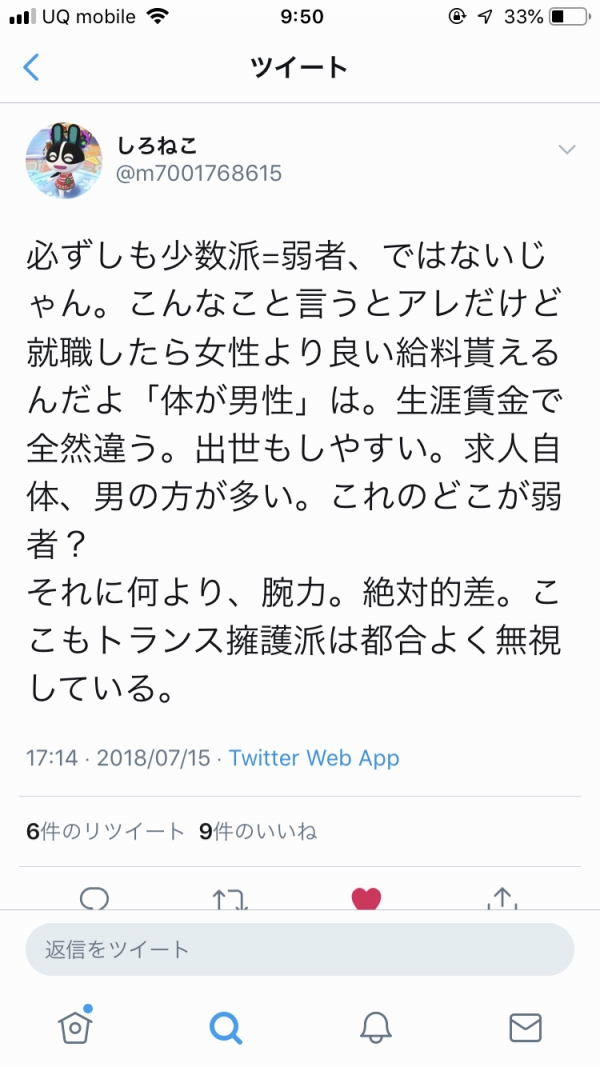

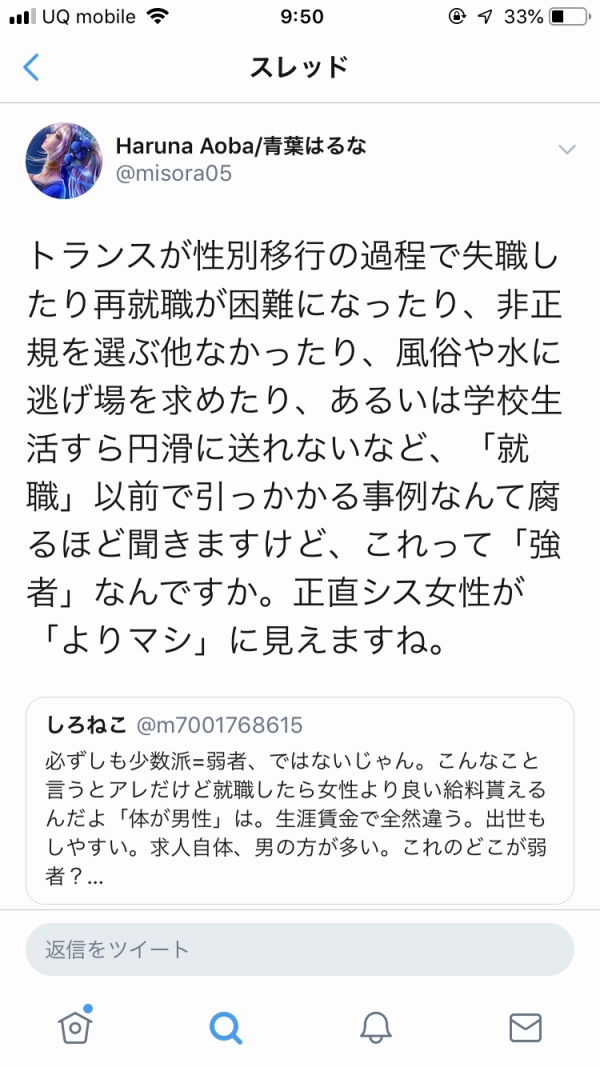

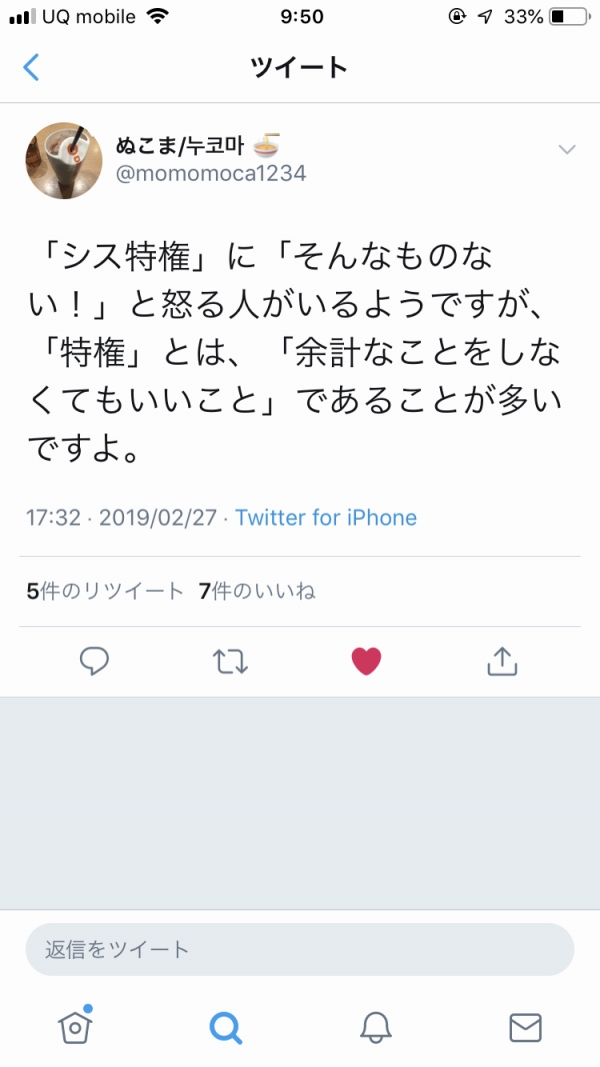

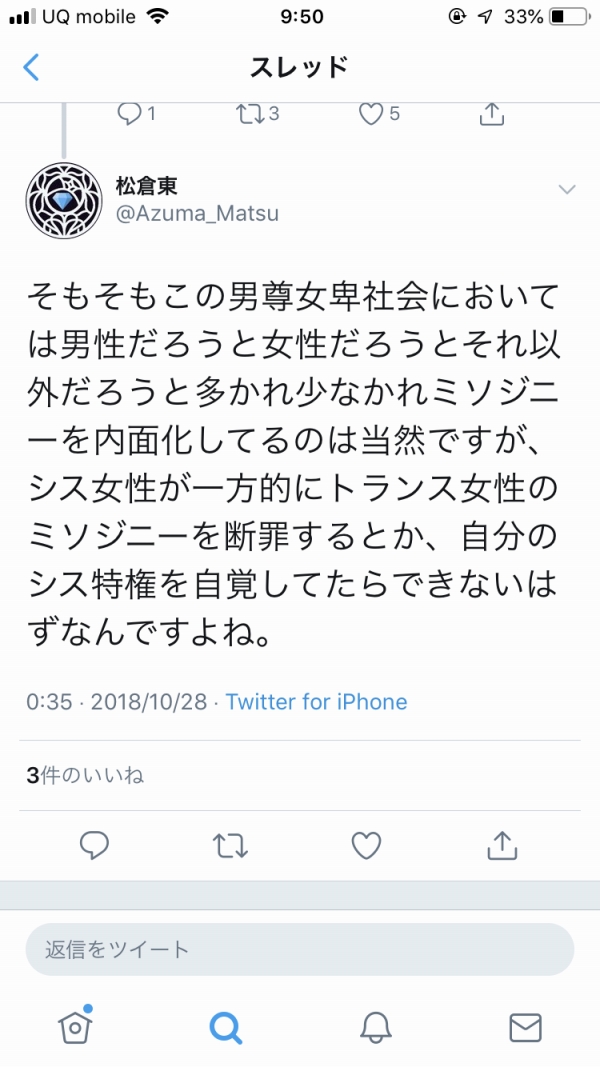

【悲報】フェミ女性さん、トランス女性にブチギレ 「私たちの方が弱者だ!!!お前らは弱者ぶるな!!!!」

1 : 番組の途中ですがアフィサイトへの\(^o^)/です (アウアウクー MM0b-YxMM):2019/02/28(木) 09:52:53.79 ID:hpvPqT/qM

フェミさんが喧嘩を売る

トランスさんが買う

211 : 番組の途中ですがアフィサイトへの\(^o^)/です (ワッチョイ 9f94-W5e4):2019/02/28(木) 11:01:33.54 ID:m18Dw0YN05

フェミ「あたしたちのほうがバカでのろまな無能!」

408 : 番組の途中ですがアフィサイトへの\(^o^)/です (ワッチョイW 5740-nudY):2019/02/28(木) 14:30:08.12 ID:Ko9Yisgq0

まーんwww

2 : 番組の途中ですがアフィサイトへの\(^o^)/です (アウアウクー MM0b-YxMM):2019/02/28(木) 09:53:08.80 ID:hpvPqT/qM

弱者合戦草

≫続きを読んで世界ランクアップ!

フェミさんが喧嘩を売る

トランスさんが買う

211 : 番組の途中ですがアフィサイトへの\(^o^)/です (ワッチョイ 9f94-W5e4):2019/02/28(木) 11:01:33.54 ID:m18Dw0YN05

フェミ「あたしたちのほうがバカでのろまな無能!」

408 : 番組の途中ですがアフィサイトへの\(^o^)/です (ワッチョイW 5740-nudY):2019/02/28(木) 14:30:08.12 ID:Ko9Yisgq0

まーんwww

2 : 番組の途中ですがアフィサイトへの\(^o^)/です (アウアウクー MM0b-YxMM):2019/02/28(木) 09:53:08.80 ID:hpvPqT/qM

弱者合戦草

≫続きを読んで世界ランクアップ!

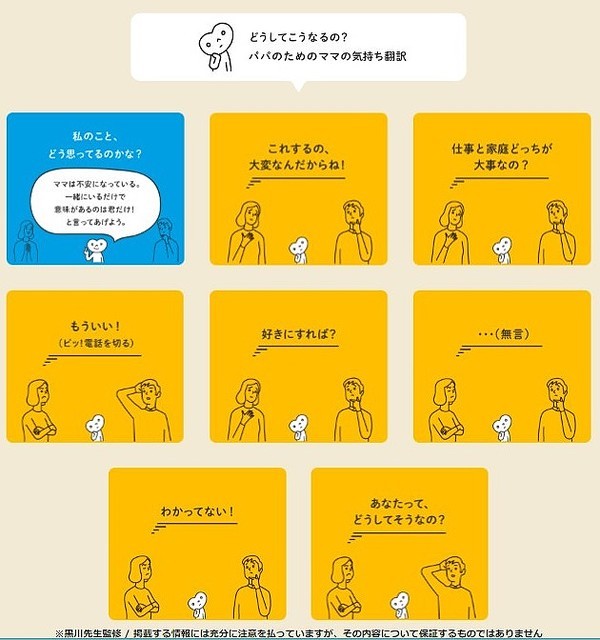

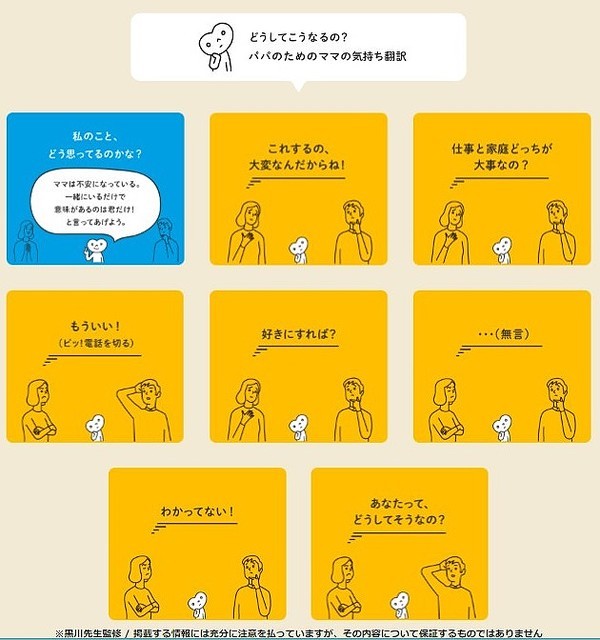

【悲報】「ママの気持ち翻訳アプリ」に女性達がマジ切れ経血大決壊 「女性をバカにするな!!!!」

1 : 番組の途中ですがアフィサイトへの\(^o^)/です (ワッチョイ 59db-PgJe):2019/02/24(日) 15:59:19.94 ID:5Exs7WKe0

グリコの「こぺ」が炎上。「パパのためのママの気持ち翻訳」が女性をバカにしてると批判殺到

https://onmtp.jp/2565

グリコのアプリ「こぺ」のリリース記念コンテンツ「パパのためのママの気持ち翻訳」が女性軽視の内容であると炎上しています。

グリコが2月6日にリリースした夫婦間のコミュニケーションや育児協同を促すためのアプリ「こぺ」。

リリース記念として公式サイトでは妻から夫への言葉を翻訳した「パパのためのママの気持ち翻訳」が掲載されていました。

一緒にいる意味ないよね?

↓

私のことどう思ってるのかな?

もういい!(ピッ!電話を切る)

↓

ほんとは甘えたいの

このように妻が本当に言いたい事を翻訳してくれるというもの。

サイトには「掲載する情報には充分注意を払っていますが、その内容について保証するものはありません」との記載がありました。

この企画に対して批判が殺到。

バウリンガルとかニャウリンガルと同じ。

つまり、ママは「犬猫と一緒」。

恐ろしいほどの女性蔑視ですね。男性が女性の言っていることが分からないのは、彼らが彼女に寄り添う努力をしていないからですよ。きっと、パパ語を翻訳したら「育児したくねえ、女で全部やれ」になるんじゃないですか?

292 : 番組の途中ですがアフィサイトへの\(^o^)/です (ワッチョイ c501-X3b8):2019/02/24(日) 16:43:19.35 ID:cCXBGI0H0

ほらすぐ怒る

17 : 番組の途中ですがアフィサイトへの\(^o^)/です (ワッチョイWW 6dc5-Xghs):2019/02/24(日) 16:04:15.09 ID:nSI7hrwt0

めんどくせえ

4 : 番組の途中ですがアフィサイトへの\(^o^)/です (ワッチョイW 6ad1-29PY):2019/02/24(日) 16:00:25.09 ID:g0D5BgNd0

まんさんがお怒りの様子です

≫続きを読んで世界ランクアップ!

グリコの「こぺ」が炎上。「パパのためのママの気持ち翻訳」が女性をバカにしてると批判殺到

https://onmtp.jp/2565

グリコのアプリ「こぺ」のリリース記念コンテンツ「パパのためのママの気持ち翻訳」が女性軽視の内容であると炎上しています。

グリコが2月6日にリリースした夫婦間のコミュニケーションや育児協同を促すためのアプリ「こぺ」。

リリース記念として公式サイトでは妻から夫への言葉を翻訳した「パパのためのママの気持ち翻訳」が掲載されていました。

一緒にいる意味ないよね?

↓

私のことどう思ってるのかな?

もういい!(ピッ!電話を切る)

↓

ほんとは甘えたいの

このように妻が本当に言いたい事を翻訳してくれるというもの。

サイトには「掲載する情報には充分注意を払っていますが、その内容について保証するものはありません」との記載がありました。

この企画に対して批判が殺到。

バウリンガルとかニャウリンガルと同じ。

つまり、ママは「犬猫と一緒」。

恐ろしいほどの女性蔑視ですね。男性が女性の言っていることが分からないのは、彼らが彼女に寄り添う努力をしていないからですよ。きっと、パパ語を翻訳したら「育児したくねえ、女で全部やれ」になるんじゃないですか?

? プデチゲ(えび入り) (@PUCZbjrTWyW1QBq) 2019年2月20日

女性が男性と同等に人間であることを理解してますか?

今すぐに削除なさいませ。

292 : 番組の途中ですがアフィサイトへの\(^o^)/です (ワッチョイ c501-X3b8):2019/02/24(日) 16:43:19.35 ID:cCXBGI0H0

ほらすぐ怒る

17 : 番組の途中ですがアフィサイトへの\(^o^)/です (ワッチョイWW 6dc5-Xghs):2019/02/24(日) 16:04:15.09 ID:nSI7hrwt0

めんどくせえ

4 : 番組の途中ですがアフィサイトへの\(^o^)/です (ワッチョイW 6ad1-29PY):2019/02/24(日) 16:00:25.09 ID:g0D5BgNd0

まんさんがお怒りの様子です

≫続きを読んで世界ランクアップ!

【悲報】キリストや釈迦、哲学者に続きAIまでもが女叩きをしてしまう

1: ニライカナイφ ★ 2019/02/21(木) 06:26:15.81 ID:fpLqAPn29

◆ AIは中立ではなく「女性嫌い」 検証結果で見えてきた負の側面

人工知能(AI)による採用審査など、日本でもAI社会の広がりを身近に感じるようになった。

だが、AIには「女性嫌い」という厄介な偏見があり、「ヘイト」を増幅させる危険性もある。

朝日新聞IT専門記者の平和博氏がAIの実態をレポートする。

IT5社の人工知能(AI)が男性を女性に間違える割合はコンマ以下。

一方、女性を男性に間違える割合は最大で2割近い──。

マサチューセッツ工科大学(MIT)メディアラボの研究者、ジョイ・ブォラムウィニ氏らは今年1月28日、ハワイ・ホノルルで開かれていた米国人工知能学会と米国計算機学会の会議で、AIが人の顔の画像から性別などの特徴を識別する「顔認識」について、IT各社の機能を比較した結果を発表した。

比較したのは、IBM、マイクロソフト、アマゾン、さらに米国のベンチャー「カイロス」と中国のサービス「フェイス++」の5社。

その結果には、共通する傾向があった。

いずれも男性を女性に間違える割合は1%未満なのに、女性を男性に間違える割合は、はるかに高かった。

最大のアマゾンでは19%。5人に1人の割合で女性を男性と判定するということだ。

つまり、いずれも女性に不利な傾向を示していたのだ。

さらにアマゾンでは、別の観点からもAIによる女性の扱いが問題となっていた。

AIを使った人材採用システムをアマゾンが開発しようとしたが、AIが「女性嫌い」で使い物にならず、断念した──ロイターが2018年10月にそう報じている。

アマゾンは14年に専任チームを立ち上げ、AIによって履歴書を審査するためのシステム開発に取り組み始めた。

AIが応募者の履歴書の内容を評価し、5点満点でランク付けする、という仕組みだった。

だが不具合が明らかになる。ソフトウェア開発などの技術職で、女性に対しての評価が低くなるという偏りが生じていたのだ。

原因は、AIが学習したデータにあった。

AIは、あらかじめデータを使って学び、その中からモデルとなる特徴を見つけ出す。

このモデルに基づいて新しいデータの仕分けなどの作業を行う。

だから、学習するデータに問題があれば、AIから出てくる判定結果にも問題が生じる。

●学習データに基づくAI、正確で中立だとは限らない

システム開発に際して担当者たちは、過去10年にわたって同社に提出された履歴書をAIに学習させた。

問題は、その大半が男性からのものだったということだ。そして、採用された技術職も大半が男性だ。

するとどうなるか? AIは男性の方が採用に適した人材と判断し、男性の履歴書の評価を高くするようになってしまう。

その結果、履歴書に「女性チェス部部長」のように「女性」という言葉が入っていると評価を下げていたのだ。

女子大卒業という履歴書で評価を下げられたケースもあったという。

「女性」に関連する言葉での差別が行われないよう、システムに修正を加えたが、そのほかの差別が生じる可能性を否定できず、アマゾンは17年初めに開発を断念。専任チームは解散した。

AIに期待されるのは、正確さや中立性、そして高速で大量のデータ処理をすることだ。

ただ、AIが正確で中立だとは限らない。

社会に差別や偏見があれば、AIもデータを通じて差別や偏見を学ぶ。

しかも単に反復するだけでなく、高速な自動処理によって、それを増幅させてしまう危険性もある。

平成も終わろうといういま、なお「女性嫌い」の価値観が、AIから吐き出されるかもしれないのだ。

アマゾンでは開発を断念したが、AIを使った採用システムは様々な企業で取り入れられ、日本でも導入が始まっている。

ソフトバンクは17年5月から、新卒採用選考のエントリーシート評価に、IBMのAI「ワトソン」を導入した。

「ワトソン」の自然言語処理の機能を使い、エントリーシートの内容を判定。

合格基準を満たした項目は選考通過とし、その他の項目は人間の人事担当者が確認して最終判断を行う。

「応募者をより客観的に、また適正に評価する」としている。

「ワトソン」は11年、米国の人気クイズ番組で人間のクイズ王者2人に圧勝したことで知られる。

導入することで、書類評価にかかる時間を75%削減し、面接にあてるという。

※続きは下記のソースでご覧ください

AERA 2019.2.20 17:00

https://dot.asahi.com/aera/2019021900059.html?page=1

人工知能(AI)による採用審査など、日本でもAI社会の広がりを身近に感じるようになった。

だが、AIには「女性嫌い」という厄介な偏見があり、「ヘイト」を増幅させる危険性もある。

朝日新聞IT専門記者の平和博氏がAIの実態をレポートする。

IT5社の人工知能(AI)が男性を女性に間違える割合はコンマ以下。

一方、女性を男性に間違える割合は最大で2割近い──。

マサチューセッツ工科大学(MIT)メディアラボの研究者、ジョイ・ブォラムウィニ氏らは今年1月28日、ハワイ・ホノルルで開かれていた米国人工知能学会と米国計算機学会の会議で、AIが人の顔の画像から性別などの特徴を識別する「顔認識」について、IT各社の機能を比較した結果を発表した。

比較したのは、IBM、マイクロソフト、アマゾン、さらに米国のベンチャー「カイロス」と中国のサービス「フェイス++」の5社。

その結果には、共通する傾向があった。

いずれも男性を女性に間違える割合は1%未満なのに、女性を男性に間違える割合は、はるかに高かった。

最大のアマゾンでは19%。5人に1人の割合で女性を男性と判定するということだ。

つまり、いずれも女性に不利な傾向を示していたのだ。

さらにアマゾンでは、別の観点からもAIによる女性の扱いが問題となっていた。

AIを使った人材採用システムをアマゾンが開発しようとしたが、AIが「女性嫌い」で使い物にならず、断念した──ロイターが2018年10月にそう報じている。

アマゾンは14年に専任チームを立ち上げ、AIによって履歴書を審査するためのシステム開発に取り組み始めた。

AIが応募者の履歴書の内容を評価し、5点満点でランク付けする、という仕組みだった。

だが不具合が明らかになる。ソフトウェア開発などの技術職で、女性に対しての評価が低くなるという偏りが生じていたのだ。

原因は、AIが学習したデータにあった。

AIは、あらかじめデータを使って学び、その中からモデルとなる特徴を見つけ出す。

このモデルに基づいて新しいデータの仕分けなどの作業を行う。

だから、学習するデータに問題があれば、AIから出てくる判定結果にも問題が生じる。

●学習データに基づくAI、正確で中立だとは限らない

システム開発に際して担当者たちは、過去10年にわたって同社に提出された履歴書をAIに学習させた。

問題は、その大半が男性からのものだったということだ。そして、採用された技術職も大半が男性だ。

するとどうなるか? AIは男性の方が採用に適した人材と判断し、男性の履歴書の評価を高くするようになってしまう。

その結果、履歴書に「女性チェス部部長」のように「女性」という言葉が入っていると評価を下げていたのだ。

女子大卒業という履歴書で評価を下げられたケースもあったという。

「女性」に関連する言葉での差別が行われないよう、システムに修正を加えたが、そのほかの差別が生じる可能性を否定できず、アマゾンは17年初めに開発を断念。専任チームは解散した。

AIに期待されるのは、正確さや中立性、そして高速で大量のデータ処理をすることだ。

ただ、AIが正確で中立だとは限らない。

社会に差別や偏見があれば、AIもデータを通じて差別や偏見を学ぶ。

しかも単に反復するだけでなく、高速な自動処理によって、それを増幅させてしまう危険性もある。

平成も終わろうといういま、なお「女性嫌い」の価値観が、AIから吐き出されるかもしれないのだ。

アマゾンでは開発を断念したが、AIを使った採用システムは様々な企業で取り入れられ、日本でも導入が始まっている。

ソフトバンクは17年5月から、新卒採用選考のエントリーシート評価に、IBMのAI「ワトソン」を導入した。

「ワトソン」の自然言語処理の機能を使い、エントリーシートの内容を判定。

合格基準を満たした項目は選考通過とし、その他の項目は人間の人事担当者が確認して最終判断を行う。

「応募者をより客観的に、また適正に評価する」としている。

「ワトソン」は11年、米国の人気クイズ番組で人間のクイズ王者2人に圧勝したことで知られる。

導入することで、書類評価にかかる時間を75%削減し、面接にあてるという。

※続きは下記のソースでご覧ください

AERA 2019.2.20 17:00

https://dot.asahi.com/aera/2019021900059.html?page=1

8: 名無しさん@1周年 2019/02/21(木) 06:29:48.07 ID:HlI4IpyB0

AIがここまで正しい判断ができるとはな

68: 名無しさん@1周年 2019/02/21(木) 07:21:14.99 ID:AQ39nkuU0

性欲が完全にない状態ならそりゃそうなるよな

≫続きを読んで世界ランクアップ!

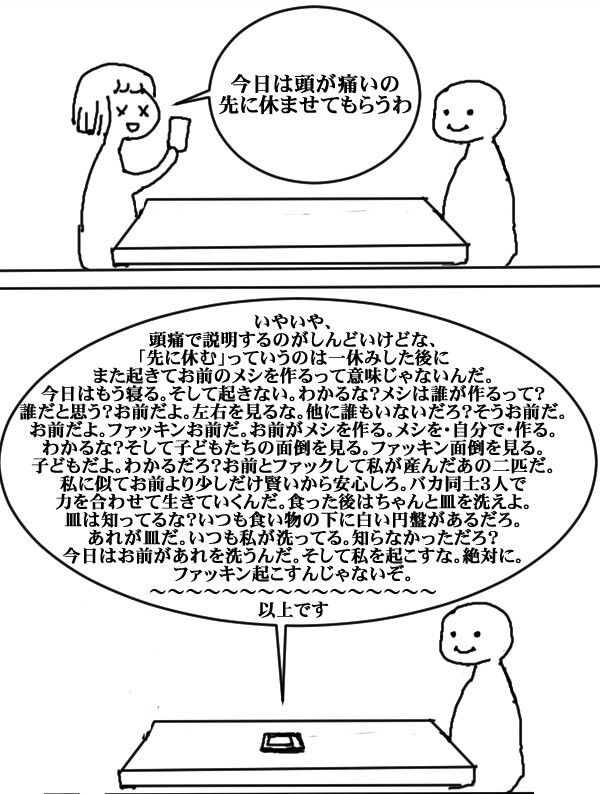

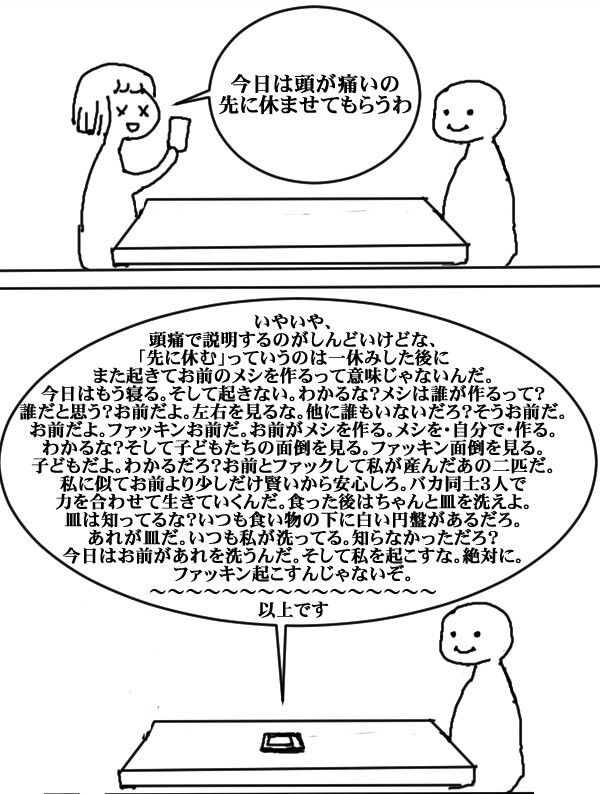

【悲報】日本の男さん、女性の「今日は頭が痛いから先に休むね」という言葉にどれほどの意味が込められているか察することができないw

1 : ちちちち~ん:2019/02/22(金) 12:04:41.15 ID:LsSUrMSpF

169 : 番組の途中ですがアフィサイトへの\(^o^)/です:2019/02/22(金) 16:27:05.59 ID:xw3jZndbM

そう…

55 : 番組の途中ですがアフィサイトへの\(^o^)/です:2019/02/22(金) 12:24:01.84 ID:hz1urPlxr

知るかよボケ

6 : 番組の途中ですがアフィサイトへの\(^o^)/です:2019/02/22(金) 12:06:19.91 ID:0G+i44nnM

めんどくせ

死ね

≫続きを読んで世界ランクアップ!

169 : 番組の途中ですがアフィサイトへの\(^o^)/です:2019/02/22(金) 16:27:05.59 ID:xw3jZndbM

そう…

55 : 番組の途中ですがアフィサイトへの\(^o^)/です:2019/02/22(金) 12:24:01.84 ID:hz1urPlxr

知るかよボケ

6 : 番組の途中ですがアフィサイトへの\(^o^)/です:2019/02/22(金) 12:06:19.91 ID:0G+i44nnM

めんどくせ

死ね

≫続きを読んで世界ランクアップ!

|

|

最新記事

捗る品々

カウンター

カテゴリ

リンク

- ★スペシャルサンクス★

- ニュー速VIPブログ(`・ω・´)

- ハムスター速報

- 【2ch】ニュー速クオリティ

2chまとめアンテナ

- LogPo!2ch

- ブーンあんてな

- 紳士協定

- まとめちゃんねる

- ハジマタあんてな\(^o^)/

- 暇人(´・д・`)あんてな

- なび風呂

- 2ブロネット

- 2chあんてな九十九尾

- ついてな

- とろたまヘッドライン

- エスノあんてなZ

- しぃアンテナ(*゚ー゚)

- VIPあんてな

- ちくあんてな

- 2chブログまとめwiki

- オマエラアンテナ

- もしもしアンテナEX(゜ω゜)

- 2chセンター

- まとめステーション

- 2chまとめインデックス

- しょぼんアンテナ

2chまとめサイト

- ナリ速

- ろぼ速VIP

- ゴタゴタシタニュース

- 情弱!!ゆとりnews

- まめ速

- パンデモニウム速報

- 乙ちゃんねる!

- とりのまるやき

- かぎまとめ

- ニュー投

- もわっっ。

- ν即のまとめ

- おもいっきり濁点

- (´・ω・`)ショボーン速報

- ちか速

- ベースボールスレッド

- ロン速

- あんどろいど速報

- わんこーる速報!

- るな速

- 泳ぐやる夫シアター

- 日刊やきう速報

- キムチ速報

- Thead Good Job

- 廃人ニュース

- なんJ(まとめては)いかんのか?

- ぐう速

- 2chニュース速報VIP

- スレ速

- 管理画面

逆アクセスランキング

月別アーカイブ

- 2024/01 (4)

- 2023/11 (2)

- 2023/07 (1)

- 2023/06 (4)

- 2023/05 (5)

- 2023/04 (10)

- 2022/10 (3)

- 2022/09 (1)

- 2022/08 (1)

- 2022/07 (1)

- 2022/05 (6)

- 2022/04 (4)

- 2022/03 (5)

- 2022/02 (3)

- 2022/01 (2)

- 2021/12 (6)

- 2021/11 (4)

- 2021/10 (8)

- 2021/09 (5)

- 2021/08 (5)

- 2021/07 (15)

- 2021/06 (14)

- 2021/05 (14)

- 2021/04 (16)

- 2021/03 (16)

- 2021/01 (9)

- 2020/12 (15)

- 2020/11 (13)

- 2020/10 (16)

- 2020/09 (25)

- 2020/08 (11)

- 2020/07 (24)

- 2020/06 (27)

- 2020/05 (39)

- 2020/04 (27)

- 2020/03 (23)

- 2020/02 (13)

- 2020/01 (26)

- 2019/12 (31)

- 2019/11 (35)

- 2019/10 (49)

- 2019/09 (53)

- 2019/08 (78)

- 2019/07 (93)

- 2019/06 (88)

- 2019/05 (91)

- 2019/04 (100)

- 2019/03 (94)

- 2019/02 (72)

- 2019/01 (85)

- 2018/12 (80)

- 2018/11 (72)

- 2018/10 (92)

- 2018/09 (93)

- 2018/08 (103)

- 2018/07 (116)

- 2018/06 (130)

- 2018/05 (157)

- 2018/04 (167)

- 2018/03 (165)

- 2018/02 (151)

- 2018/01 (186)

- 2017/12 (139)

- 2017/11 (169)

- 2017/10 (153)

- 2017/09 (157)

- 2017/08 (163)

- 2017/07 (163)

- 2017/06 (146)

- 2017/05 (136)

- 2017/04 (143)

- 2017/03 (162)

- 2017/02 (145)

- 2017/01 (155)

- 2016/12 (133)

- 2016/11 (145)

- 2016/10 (146)

- 2016/09 (146)

- 2016/08 (143)

- 2016/07 (144)

- 2016/06 (138)

- 2016/05 (144)

- 2016/04 (126)

- 2016/03 (133)

- 2016/02 (130)

- 2016/01 (143)

- 2015/12 (142)

- 2015/11 (129)

- 2015/10 (105)

- 2015/09 (142)

- 2015/08 (150)

- 2015/07 (146)

- 2015/06 (150)

- 2015/05 (141)

- 2015/04 (151)

- 2015/03 (167)

- 2015/02 (152)

- 2015/01 (176)

- 2014/12 (182)

- 2014/11 (160)

- 2014/10 (175)

- 2014/09 (165)

- 2014/08 (179)

- 2014/07 (175)

- 2014/06 (174)

- 2014/05 (170)

- 2014/04 (167)

- 2014/03 (159)

- 2014/02 (145)

- 2014/01 (185)

- 2013/12 (162)

- 2013/11 (160)

- 2013/10 (160)

- 2013/09 (170)

- 2013/08 (180)

- 2013/07 (171)

- 2013/06 (180)

- 2013/05 (166)

- 2013/04 (186)

- 2013/03 (196)

- 2013/02 (161)

- 2013/01 (158)

- 2012/12 (165)

- 2012/11 (148)

- 2012/10 (137)

- 2012/09 (125)

- 2012/08 (133)

- 2012/07 (144)

- 2012/06 (143)

- 2012/05 (148)

- 2012/04 (133)

- 2012/03 (124)

- 2012/02 (107)

- 2012/01 (106)

- 2011/12 (118)

- 2011/11 (110)

- 2011/10 (112)

- 2011/09 (89)

- 2011/08 (88)

- 2011/07 (92)

- 2011/06 (90)

- 2011/05 (78)

- 2011/04 (99)

- 2011/03 (77)

- 2011/02 (52)

- 2011/01 (53)

- 2010/12 (55)

- 2010/11 (41)

- 2010/10 (31)

- 2010/09 (36)

- 2010/08 (31)

- 2010/07 (22)

- 2010/06 (30)

- 2010/05 (26)

- 2010/04 (18)

- 2010/03 (27)

- 2010/02 (26)

- 2010/01 (4)

検索フォーム